- AIのディープラーニング技術を使い、人物の顔や声を合成して本物そっくりの偽動画・偽音声を作る技術のこと!ディープラーニングとフェイクを組み合わせた造語だ

- 上司や有名人の顔と声を精巧に再現してなりすまし、ビデオ会議やSNS広告で送金指示や投資勧誘を行う詐欺に悪用されている。2025年第1四半期だけで被害額は世界で約290億円に達した

- 知っておくことで動画や音声も偽物の可能性があると疑う目が身につき、送金や機密情報の提供を求められたら必ず別ルートで本人確認する習慣が対策になる

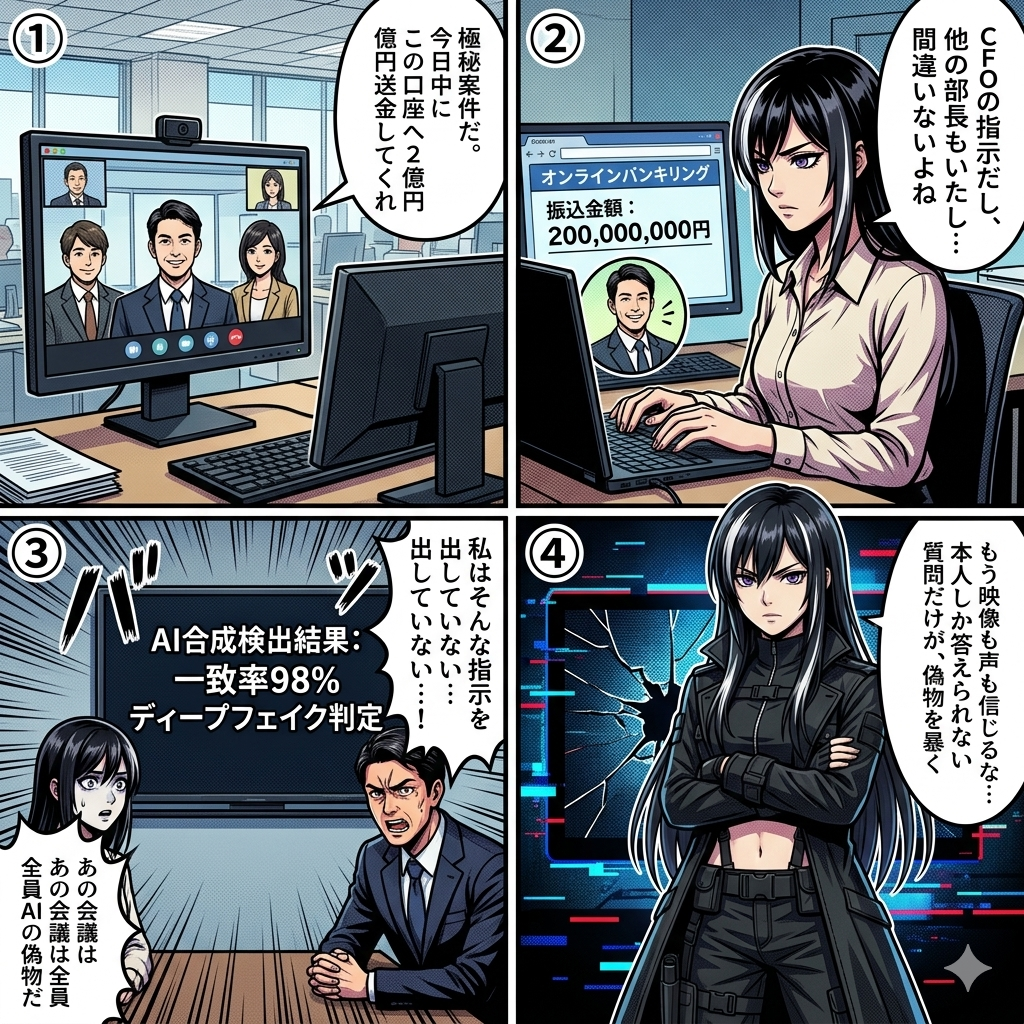

この4コマが突きつけているのは、ビデオ会議に映る顔も、聞こえる声も、もはや本人であることの証明にはならないというAI時代の新たな現実です。2024年に香港で実際に発生した事件では、ビデオ会議に参加していたCFOも同僚も全員がAIで合成されたディープフェイクであり、経理担当者は約38億円を犯罪グループの口座に送金してしまいました。

主人公が騙された最大の要因は、映像と音声を信頼の根拠にしてしまった点にあります。複数の参加者が画面にいたことが信憑性を高め、緊急性と秘密性の強調で確認の時間も封じられました。現在のディープフェイク技術は、わずか数秒の音声サンプルから85%の精度で声を複製でき、68%の偽動画が本物との区別が困難なレベルに到達しています。

この被害を阻止する唯一の武器は、送金や機密情報の提供を求められた際に必ず別ルートで本人確認するという手順です。イタリアのフェラーリでは、CEOを装ったディープフェイクの電話に対し、従業員がCEOしか知らない質問を投げかけたことで詐欺を寸前で阻止しました。

映像が本物に見えるか、声が似ているかではなく、本人しか答えられない質問に正しく回答できるかどうかが、AIの偽物と本物を分ける最後の防衛線です。社内で事前に合言葉や確認質問を決めておくことが、今すぐできる最も効果的な対策になります。

【深掘り】これだけは知っておけ

ディープフェイク(Deepfake)とは、AIのディープラーニング(深層学習)技術を用いて、人物の顔や声を合成し、本物と見分けがつかないほど精巧な偽の動画・音声・画像を作成する技術、またはその成果物を指します。GAN(敵対的生成ネットワーク)と呼ばれる技術が基盤にあり、生成器が偽物を作り、識別器が本物か偽物かを判定するプロセスを繰り返すことで、限りなく本物に近い合成メディアが生成されます。

深刻なのは、この技術が詐欺に悪用されるケースが急増している点です。2024年には香港の多国籍企業で、ディープフェイクでCFO(最高財務責任者)や同僚になりすました犯罪グループがビデオ会議を開催し、経理担当者を騙して約38億円を送金させる事件が発生しました。2025年第1四半期だけで世界全体のディープフェイク詐欺の被害額は約290億円を超え、前年比で300%以上の増加を記録しています。わずか3〜5秒の音声サンプルから85%の精度で声を複製できるまでに技術が進化しており、専門知識がなくても誰でも簡単にディープフェイクを作成できる環境が整いつつあることが、被害拡大の背景にあります。日本では、ディープフェイクの作成行為自体を直接取り締まる法律がまだ存在しないという法整備の遅れも指摘されています。

典型的なフレーズ・文脈

緊急の極秘案件で、今日中にこの口座へ2億円送金してほしい。他の人には絶対に言わないでくれ。

ディープフェイクでCFOや社長になりすまし、ビデオ会議で経理担当者に送金を指示する際の典型的なセリフです。緊急性と秘密性を強調して確認の時間を与えず、他者への相談も封じることで被害者を孤立させます。

AIで作られた偽のビデオ会議で約38億円を送金させた詐欺事件が発覚しました。参加者全員がディープフェイクだったということです。

2024年の香港の巨額詐欺事件をニュースが報じる際の表現です。会議に参加していたCFOや同僚は全員AIで合成された偽物であり、被害者は正規の取引だと信じて送金してしまいました。

動画で見た顔も、電話で聞いた声も、今の時代は偽物の可能性があります。送金や情報提供を求められたら、必ず別ルートで確認してください。

セキュリティ専門家が企業研修でディープフェイク対策として繰り返し伝えるアドバイスです。イタリアのフェラーリでは、従業員がCEOしか答えられない質問を投げかけたことでディープフェイク詐欺を寸前で阻止した事例があります。

【まとめ】3つのポイント

- 目に見える映像も耳で聞く声ももう信用できない時代:ディープフェイクはわずか数秒の音声サンプルから85%の精度で声を複製でき、68%の偽動画が本物との区別が困難なレベルに達している。映像と音声だけを根拠に行動するのは危険だ

- 緊急・秘密・即断を求める送金指示は最大の危険信号:ディープフェイク詐欺の共通パターンは、緊急性と秘密性を強調して確認の時間を奪うこと。送金や機密情報の提供を求められたら、どんなに急いでいても別ルート(内線電話・対面・社内チャットの別スレッド)で本人確認すること

- 本人しか知らない質問が最強の盾になる:ディープフェイクは外見と声は完璧に再現できても、本人だけが知っている情報までは知らない。フェラーリの事例のように、合言葉や事前に決めた確認質問を設けておくことで、偽物を見破ることができる

よくある質問

-

Qディープフェイクの動画や音声を見分ける方法はありますか?

-

A

完全に見分けることは難しくなりつつありますが、いくつかの手がかりがあります。目元や口元の動きが不自然、まばたきのタイミングが一定、顔の輪郭と背景の境界がぼやけている、音声のトーンが一定で抑揚がない、といった違和感を感じたらディープフェイクの可能性を疑ってください。ただし技術は日々進化しているため、違和感がないからといって本物とは限りません。送金や情報提供を求められた場合は、映像の真偽判断に頼らず別ルートでの本人確認を優先すべきです。

-

Qディープフェイクを作ること自体は違法ですか?

-

A

日本ではディープフェイクの作成行為自体を直接取り締まる法律は現時点で存在しません。ただし、悪用の内容に応じて、名誉毀損罪、わいせつ物頒布罪、不正アクセス禁止法、詐欺罪などの既存の法律で処罰される可能性があります。海外ではアメリカのカリフォルニア州が2024年にディープフェイク対策の9つの法案に署名し、韓国では所持・視聴も処罰対象とする法案が可決されるなど、規制の動きが加速しています。

-

Q個人がディープフェイク詐欺に遭わないためにはどうすればいいですか?

-

A

最も効果的な対策は3つあります。まず、SNSで自分の顔写真や音声を不必要に公開しないこと(AIの学習素材を減らす)。次に、ビデオ通話や電話で送金や個人情報を求められたら、一度切って別の連絡手段で本人に直接確認すること。そして、有名人が投資や商品を勧めるSNS広告の動画は、たとえ本物に見えても公式サイトで情報の裏取りをしてから判断すること。映像や音声を鵜呑みにしない習慣が最大の防御になります。

-

Qディープフェイクとフェイクニュースとの違いは何ですか?

-

A

フェイクニュースは嘘や誤った情報を含むニュース全般を指す広い概念で、テキストだけの虚偽記事も含まれます。一方ディープフェイクは、AI技術を使って実在の人物の顔や声を合成した偽の動画・音声・画像のことを指します。つまりディープフェイクはフェイクニュースを作るための技術手段の一つであり、特にAIによる映像・音声の偽造に特化している点が違いです。ディープフェイクで作った偽動画がフェイクニュースとして拡散されるという関係にあります。

【出典】参考URL

https://ja.wikipedia.org/wiki/%E3%83%87%E3%82%A3%E3%83%BC%E3%83%97%E3%83%95%E3%82%A7%E3%82%A4%E3%82%AF :ディープフェイクの定義・技術・法規制・被害事例の包括的解説

https://www.trendmicro.com/ja_jp/jp-security/24/g/securitytrend-20240703-02.html :ディープフェイクに関する実態調査2024年版(トレンドマイクロ)

https://www.sbbit.jp/article/cont1/166569 :2025年第1四半期の被害額290億円超と最新動向の解説

https://www.lanscope.jp/blogs/cyber_attack_dt_blog/20250228_25331/ :香港38億円詐欺事件の詳細とフェラーリの阻止事例

https://jp.weforum.org/stories/2025/08/deepfake-legislation-denmark-digital-id-ja/ :世界のディープフェイク規制動向と被害統計(世界経済フォーラム)

コメント